Si lanzas una campaña sobre un “regalo”, es posible que obtengas muchos contactos de lugares de habla inglesa, pero de Alemania, lo único que recibirás serán informes y prohibiciones. ¿Te preguntas por qué? 🤔

Aquí es donde la moderación de contenido entra en acción para salvar el día. Ahora que ya estás convencido de por qué tu campaña requiere moderación de contenido, profundicemos y veamos qué más puede hacer por ti. 👇

El papel de la moderación de contenidos

Todos sabemos que Internet no tiene fronteras y que las ideas circulan libremente, pero esta libertad conlleva desafíos. Las conversaciones pueden volverse confusas y la diversidad de opiniones a veces genera confusión.

Aquí es donde entra en juego la moderación de contenidos, como un guardián digital.

No se trata sólo de decir sí o no; se trata de mantener la seguridad, permitir que se escuchen las voces y detener los efectos nocivos.

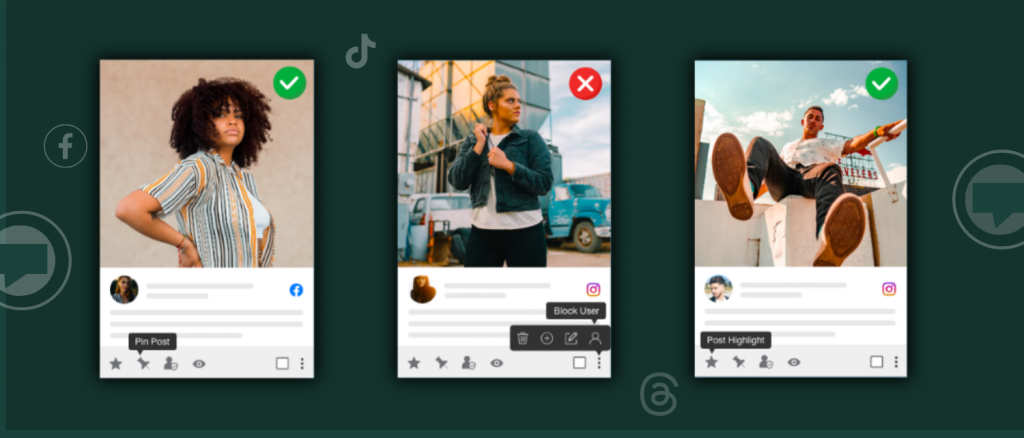

Explora la herramienta de moderación avanzada

Garantizar la seguridad del usuario y la salud de la comunidad en línea:

La moderación de contenido es esencial para crear un entorno seguro y acogedor para los usuarios y para abordar los riesgos potenciales que plantea la IA generativa. Al identificar y filtrar activamente el contenido generado por IA que pueda incluir información dañina, engañosa o manipulada, las plataformas en línea pueden mitigar la propagación de la desinformación y prevenir posibles daños a los usuarios. Además, la integración de herramientas de acceso seguro, como una VPN de acceso remoto, puede proteger aún más los datos de los usuarios y garantizar que los equipos de moderación operen en un entorno seguro y privado. Si el contenido también está bloqueado geográficamente, el uso de proxies residenciales estáticos en ubicaciones globales puede ayudar a moderar el contenido en todas las regiones del mundo.

Esto ayuda a generar confianza en los usuarios, fomentar la participación activa y fomentar una cultura saludable. comunidad de marca.

Cómo equilibrar la libertad de expresión y la curación responsable de contenidos:

Las plataformas en línea valoran el principio de libertad de expresión, permitiendo a los usuarios expresar sus opiniones y compartir sus pensamientos. Sin embargo, esta libertad debe equilibrarse con una selección responsable de contenidos para mantener un entorno respetuoso e inclusivo.

La moderación de contenido garantiza que, si bien los usuarios pueden expresarse, lo hagan dentro de los límites del comportamiento aceptable y la comunicación respetuosa.

Protección contra contenido dañino, ilegal o inapropiado:

La moderación de contenido protege contra contenido que pueda causar daño, difundir información errónea o infringir leyes y regulaciones. Previene la difusión de material ilegal, como contenido protegido por derechos de autor, software pirateado y sustancias prohibidas.

Además, ayuda a proteger a los usuarios de la exposición a contenido explícito o gráfico que podría ser inapropiado para audiencias específicas.

Una moderación de contenido eficaz implica una combinación de moderadores humanos y sistemas automatizados que trabajan juntos para lograr el equilibrio adecuado entre estas tres funciones. Es una tarea delicada que requiere una consideración cuidadosa del contexto, las normas culturales y la naturaleza cambiante de las interacciones en línea.

Tipos de moderación de contenido

Bien, ¡vamos a ponernos manos a la obra con la moderación de contenidos! Piénsalo como un proceso de varias capas, como un sistema de seguridad para tus lugares de reunión en línea favoritos. Estos son los cuatro tipos principales de moderación de contenidos:

Premoderación: revisión del contenido antes de su publicación

Al igual que un portero que controla las identificaciones en la entrada de un club, la premoderación consiste en escanear el contenido antes de que llegue a los reflectores.

De esta manera, las cosas no tan interesantes ni siquiera salen a la luz. Es como una cuerda de terciopelo virtual para tus espacios en línea.

Posmoderación: monitoreo y eliminación de contenido luego de su publicación

La posmoderación es como limpiar después de una gran fiesta. Primero se publica el contenido y luego el equipo de moderación entra en acción para ver si hay algo que se deba limpiar.

Si algo no funciona, se elimina rápidamente. Es como tener un conserje con ojo de águila para el mundo online.

Moderación reactiva: cómo responder a los informes y comentarios de los usuarios

Imagina que estás en un picnic y alguien ve un nido de avispas. Se lo dirías al organizador. De igual forma, la moderación reactiva depende de que los usuarios den la alarma cuando ven contenido problemático. El equipo de moderación toma medidas, como si se deshicieran de esas molestas avispas.

Moderación proactiva: uso de inteligencia artificial y algoritmos para detectar contenido problemático

Aquí es donde intervienen los magos de la tecnología. La IA y los algoritmos inteligentes escanean montones de contenido en busca de señales de alerta.

Son como perros de caza virtuales que detectan todo lo que no pertenece a su entorno. Es como tener gafas superpoderosas que pueden detectar problemas a kilómetros de distancia.

Por lo tanto, a medida que profundizamos en la moderación de contenido, tenga en cuenta estos aspectos. Son la fórmula secreta que mantiene viva la fiesta en línea y a raya a los trolls y alborotadores.

Moderar el contenido antes de publicarlo

Desafíos en la moderación de contenido

Hablemos de los desafíos: los obstáculos que los equipos de moderación de contenido enfrentan como superhéroes digitales. Imaginemos que intentamos mantener bajo control a una multitud que asiste a un concierto masivo: es un poco así, pero en el mundo online.

Aquí están los cuatro grandes:

Escala: cómo manejar cantidades masivas de contenido generado por el usuario

Piense en la cantidad de cosas que la gente comparte en línea cada segundo. Ahora imagine examinarlas todas para detectar cualquier comportamiento indisciplinado. Ese es el desafío de la escala.

Los equipos de moderación de contenido deben gestionar un flujo constante de publicaciones, comentarios, vídeos y más. En este sentido, el uso de la IA podría ser beneficioso para apoyar a los editores humanos. Existen numerosos ejemplos de IA generativa que moderan publicaciones, hilos e incluso imágenes a gran escala.

Subjetividad: navegando entre diferencias culturales y perspectivas diversas

¿Alguna vez has tenido un debate amistoso en el que te diste cuenta de que alguien más veía las cosas de manera totalmente diferente? Ahora imagina eso a escala global.

El contenido se puede interpretar de muchas maneras, según la cultura, los antecedentes y las opiniones personales. Los moderadores deben caminar por la cuerda floja y asegurarse de que las mismas reglas se apliquen de manera justa a todos, sin importar de dónde sean.

Contexto: Comprender la intención detrás del contenido para una moderación precisa

Las palabras pueden ser complicadas. “Cool” puede significar excelente o frío, según el contexto. De manera similar, puede resultar difícil entender si una publicación pretende ser divertida, informativa u ofensiva.

Los equipos de moderación de contenido juegan al detective, tratando de descubrir qué se considera una broma inofensiva y qué cruza el límite.

Tendencias emergentes: cómo abordar nuevas formas de contenido (por ejemplo, deepfakes)

¿Recuerdas cómo tu superhéroe favorito se adapta constantemente a nuevos villanos? Pues bien, los moderadores de contenido se enfrentan a su propio némesis en constante evolución: nuevos tipos de contenido.

Los deepfakes, por ejemplo, son como cambios de forma digitales, lo que dificulta distinguir lo real de lo falso. La moderación de contenidos debe mantenerse al día con estas tendencias para mantenerse un paso por delante.

Al adentrarnos en el mundo de la moderación de contenido, ten en cuenta estos desafíos. Son los rompecabezas que los moderadores resuelven a diario para mantener nuestros espacios en línea seguros, respetuosos y agradables. Para facilitarte esta tarea, permíteme presentarte a: Taggbox 😎. Esta herramienta no solo te ayuda en la moderación de contenido sino también en recopilar, administrar y mostrar tu contenido generado por el usuario en todos sus puntos de contacto de marketing.

La mejor herramienta de moderación de contenido generado por el usuario para marcas

Estrategias de moderación de contenido

Bien, analicemos el tema. Imaginemos que la moderación de contenido es como un trabajo en equipo: humanos y tecnología uniendo fuerzas para mantener el mundo en línea increíble. Aquí le contamos cómo lo hacen:

Moderación humana

Es como tener amigos vigilantes que te cuidan en el vecindario digital. Mira lo que están haciendo:

- Importancia de contar con equipos de moderación bien capacitados y diversos:

El hecho de que haya distintas personas en el equipo implica distintas perspectivas. Esto ayuda a detectar cosas complicadas que las máquinas no captarían. Es como tener amigos de todo el mundo para mantener el equilibrio.

- Establecer pautas y protocolos claros:

Piense en estas reglas para asegurarse de que todos jueguen de manera justa. Los moderadores siguen estas reglas para decidir si el contenido es adecuado. Es como tener reglas de juego para el patio de juegos en línea.

- Cómo afrontar el desgaste psicológico de los moderadores:

Mirar cosas no tan agradables todo el día puede ser duro. Los moderadores necesitan apoyo para mantener la calma. Después de todo, son los héroes que mantienen todo limpio y seguro.

AI y automatización

Ahora, conozca a los compañeros digitales que ayudan:

- Papel del aprendizaje automático en la detección de contenido:

Las máquinas aprenden patrones, como tu mascota, que aprende dónde están las golosinas. Detectan cosas que podrían no estar ahí al analizar toneladas de información. Son ideales para manejar grandes cantidades de contenido.

- Beneficios y limitaciones de la moderación automatizada:

Las máquinas son inteligentes, pero no perfectas. A veces se les escapan cosas complicadas o se equivocan al hacer algo. Son como amigos de confianza que a veces necesitan una mano.

- La necesidad permanente de supervisión humana:

Los humanos tienen máquinas con poderes secretos que carecen de comprensión de los sentimientos y de las situaciones complicadas. Verifican dos veces lo que encuentran las máquinas para asegurarse de que todo esté en orden.

A medida que se adentra en la moderación de contenido, recuerde este esfuerzo en equipo. Los humanos y la tecnología garantizan que el mundo en línea se mantenga amigable, divertido y respetuoso.

El futuro de la moderación de contenidos

¿Está listo para mirar la bola de cristal de la moderación de contenido? El futuro ofrece posibilidades emocionantes que darán forma a la forma en que interactuamos en línea. Vea lo que se avecina:

- Avances en IA y tecnología:

Imagina que la tecnología se vuelve aún más inteligente, como si tu mascota aprendiera nuevos trucos. La IA será más capaz de detectar contenido engañoso, lo que hará que el mundo en línea sea más seguro. Estamos hablando de algoritmos superinteligentes que pueden leer emociones y comprender el contexto como verdaderos profesionales.

- Colaboración entre plataformas, responsables de políticas y usuarios:

Imaginemos un escuadrón de superhéroes que se reúne. Las plataformas en línea, las personas que crean las reglas y nosotros, los usuarios, trabajaremos de la mano. Esto significa reglas que tienen sentido y un patio de juegos en línea que todos ayudamos a mantener limpio.

- Educación y responsabilidad del usuario para contribuir a un entorno digital seguro:

Imaginemos que todos nos convirtiéramos en superhéroes digitales. Como usuarios, aprenderíamos qué es lo que está de moda y qué no en el mundo online. Al igual que aprendemos a reciclar, contribuiremos a un espacio digital más limpio y amable siendo ciudadanos de la red responsables.

Así que prepárese para un futuro en el que la tecnología se vuelve más inteligente, las plataformas y las personas se unen para brindar una mejor experiencia en línea y todos contribuyen para garantizar que el ámbito digital siga siendo divertido, respetuoso y genial para todos.

Mostrar, ocultar y eliminar desde un solo lugar

Conclusión

¡Vaya exploración! Resumamos todo lo relacionado con la moderación de contenido y lo que nos espera:

¿Recuerdas a esos héroes anónimos que trabajan detrás de escena? La moderación de contenido mantiene nuestros lugares de reunión digitales limpios, seguros y llenos de energía positiva. Es como tener manos invisibles que se aseguran de que todos se diviertan.

El cambio es constante y el mundo online no es la excepción. La moderación de contenidos seguirá evolucionando a medida que surjan nuevas tendencias y desafíos. Mantén la curiosidad y la mente abierta, ya que el viaje está lejos de terminar.

Al despedirnos, hagamos un brindis virtual por los superhéroes digitales (los moderadores, los magos de la tecnología y los usuarios responsables) que hacen del ámbito online un refugio acogedor para voces diversas, expresión creativa e interacciones respetuosas.

Brindemos por un futuro en el que el mundo en línea refleje lo mejor de la humanidad: amabilidad, comprensión y unidad. ¡Sigamos explorando, aprendiendo y difundiendo el amor digital!