Se gestisci una campagna su un "regalo", potresti ottenere molti lead da località di lingua inglese, ma dalla Germania, tutto ciò che otterrai saranno segnalazioni e divieti. Ti stai chiedendo perché? 🤔

Ecco dove la moderazione dei contenuti entra in gioco per salvare la situazione. Ora che sei già convinto del motivo per cui la tua campagna richiede la moderazione dei contenuti, approfondiamo e vediamo cos'altro può fare per te. 👇

Il ruolo della moderazione dei contenuti

Sappiamo tutti che Internet non ha confini e qui le idee vagano libere, ma con questa libertà arrivano anche le sfide. Le conversazioni possono diventare caotiche e opinioni diverse a volte portano alla confusione.

È qui che entra in gioco la moderazione dei contenuti, come un guardiano digitale.

Non si tratta solo di dire sì o no; si tratta di mantenere le cose al sicuro, far sentire la propria voce e fermare gli effetti dannosi.

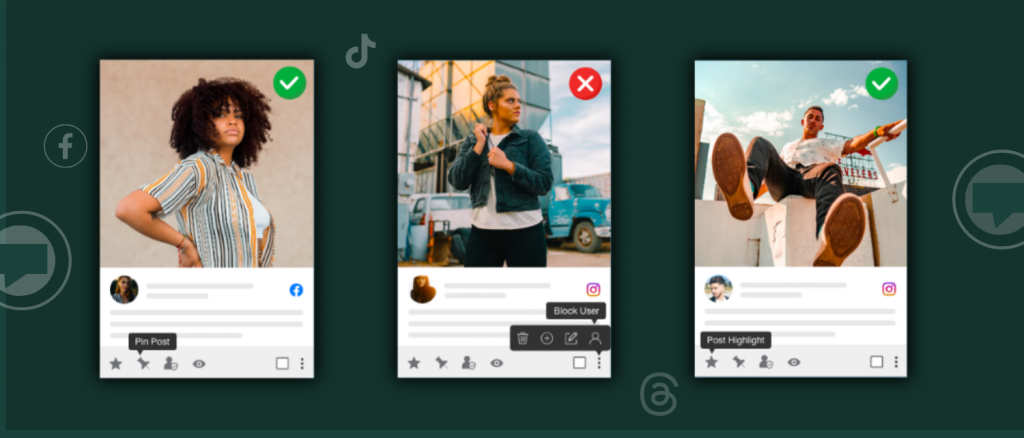

Esplora lo strumento di moderazione avanzata

Garantire la sicurezza degli utenti e la salute della comunità online:

La moderazione dei contenuti è essenziale per creare un ambiente sicuro e accogliente per gli utenti e per affrontare i potenziali rischi posti dall'intelligenza artificiale generativa. Identificando e filtrando attivamente i contenuti generati dall'IA che potrebbero includere informazioni dannose, fuorvianti o manipolate, le piattaforme online possono mitigare la diffusione della disinformazione e prevenire potenziali danni agli utenti. Inoltre, l'integrazione di strumenti di accesso sicuro come una VPN per l'accesso remoto può proteggere ulteriormente i dati degli utenti, garantendo al contempo che i team di moderazione operino in un ambiente sicuro e privato. Se i contenuti sono soggetti anche a restrizioni geografiche, l'utilizzo di proxy residenziali statici in diverse località del mondo può aiutare a moderare i contenuti in tutte le regioni del globo.

Ciò aiuta a creare fiducia negli utenti, incoraggiare la partecipazione attiva e promuovere una sana comunità del marchio.

Equilibrio tra libertà di espressione e cura responsabile dei contenuti:

Le piattaforme online valorizzano il principio della libertà di espressione, consentendo agli utenti di esprimere le proprie opinioni e condividere i propri pensieri. Tuttavia, questa libertà deve essere bilanciata con una cura dei contenuti responsabile per mantenere un ambiente rispettoso e inclusivo.

La moderazione dei contenuti garantisce che gli utenti possano esprimersi, ma che ciò avvenga entro i limiti di un comportamento accettabile e di una comunicazione rispettosa.

Protezione da contenuti dannosi, illegali o inappropriati:

La moderazione dei contenuti protegge da contenuti che possono causare danni, diffondere disinformazione o violare leggi e regolamenti. Impedisce la diffusione di materiali illegali, come contenuti protetti da copyright, software pirata e sostanze proibite.

Inoltre, aiuta a proteggere gli utenti dall'esposizione a contenuti espliciti o grafici che potrebbero essere inappropriati per determinati pubblici.

Una moderazione efficace dei contenuti implica una combinazione di moderatori umani e sistemi automatizzati che lavorano insieme per trovare il giusto equilibrio tra questi tre ruoli. È un compito delicato che richiede un'attenta considerazione del contesto, delle norme culturali e della natura in evoluzione delle interazioni online.

Tipi di moderazione dei contenuti

Ok, entriamo nel vivo della moderazione dei contenuti! Pensatela come un processo a più livelli, come un sistema di sicurezza per i vostri ritrovi online preferiti. Ecco i quattro principali tipi di moderazione dei contenuti:

Pre-moderazione: revisione dei contenuti prima della loro pubblicazione

Proprio come un buttafuori che controlla i documenti all'ingresso di un locale, la pre-moderazione consiste nell'analizzare i contenuti prima che finiscano sotto i riflettori.

In questo modo, le cose non proprio cool non vedono mai la luce del giorno. È come una corda di velluto virtuale per i tuoi spazi online.

Post-moderazione: monitoraggio e rimozione dei contenuti dopo la pubblicazione

La post-moderazione è come riordinare dopo una grande festa. I contenuti vengono pubblicati per primi, e poi la squadra di moderazione si precipita a vedere se c'è qualcosa da sistemare.

Se qualcosa non va, viene rapidamente rimosso. È come avere un custode con gli occhi d'aquila per il mondo online.

Moderazione reattiva: rispondere alle segnalazioni e al feedback degli utenti

Immagina di essere a un picnic e che qualcuno avvisti un nido di vespe. Lo diresti all'organizzatore. Allo stesso modo, la moderazione reattiva si basa sul fatto che gli utenti segnalino un allarme quando notano contenuti problematici. Il team di moderazione interviene, proprio come quando si libera di quelle fastidiose vespe.

Moderazione proattiva: utilizzo dell'intelligenza artificiale e degli algoritmi per rilevare contenuti problematici

Ed è qui che entrano in gioco i maghi della tecnologia. L'intelligenza artificiale e gli algoritmi intelligenti esaminano montagne di contenuti, alla ricerca di segnali d'allarme.

Sono come segugi virtuali che fiutano tutto ciò che non appartiene a loro. È come avere degli occhiali super potenti che possono individuare i guai da un miglio di distanza.

Quindi, mentre approfondiamo la moderazione dei contenuti, tenete a mente questi sapori. Sono la salsa segreta che fa ballare la festa online, tenendo a bada troll e piantagrane.

Moderare i contenuti prima di pubblicarli

Sfide nella moderazione dei contenuti

Parliamo di sfide, gli ostacoli che i team di moderazione dei contenuti affrontano come supereroi digitali. Immagina di dover tenere sotto controllo un'enorme folla di spettatori a un concerto: è un po' così, solo nel mondo online.

Ecco i quattro più importanti:

Scala: gestione di enormi quantità di contenuti generati dagli utenti

Pensa a quanta roba le persone condividono online ogni secondo. Ora immagina di setacciare tutto per individuare qualsiasi comportamento indisciplinato. Questa è la sfida della scala.

I team di moderazione dei contenuti devono gestire un flusso ininterrotto di post, commenti, video e altro ancora. Partendo da questo presupposto, l'utilizzo dell'intelligenza artificiale potrebbe rivelarsi vantaggioso per supportare gli editor umani. Esistono numerosi esempi di intelligenza artificiale generativa in grado di moderare post, discussioni e persino immagini su larga scala.

Soggettività: navigare tra differenze culturali e prospettive diverse

Hai mai avuto un dibattito amichevole in cui ti sei reso conto che qualcun altro vedeva le cose in modo totalmente diverso? Ora immaginalo su scala globale.

Il contenuto può essere interpretato in molti modi, a seconda della cultura, del background e delle opinioni personali. I moderatori devono camminare su una corda tesa, assicurandosi che le stesse regole si applichino equamente a tutti, indipendentemente dalla loro provenienza.

Contesto: comprendere l'intento dietro il contenuto per una moderazione accurata

Le parole possono essere ingannevoli. "Cool" può significare eccellente o freddo, a seconda del contesto. Allo stesso modo, capire se un post è pensato per essere divertente, informativo o offensivo può essere difficile.

I team di moderazione dei contenuti giocano a fare i detective, cercando di capire cosa si intende per battuta innocua e cosa invece va oltre il limite.

Tendenze emergenti: affrontare nuove forme di contenuto (ad esempio, Deepfake)

Ricordi come il tuo supereroe preferito continua ad adattarsi a nuovi cattivi? Bene, i moderatori di contenuti affrontano la loro nemesi in continua evoluzione: nuovi tipi di contenuti.

I deepfake, ad esempio, sono come mutaforma digitali, rendendo difficile distinguere il vero dal falso. La moderazione dei contenuti deve tenere il passo con queste tendenze per rimanere un passo avanti.

Mentre ci addentriamo nel mondo della moderazione dei contenuti, tenete a mente queste sfide. Sono i problemi che i moderatori risolvono quotidianamente per mantenere i nostri spazi online sicuri, rispettosi e piacevoli. Per semplificarvi questo compito, permettetemi di presentarvi Taggbox 😎. Questo strumento non solo ti aiuta nella moderazione dei contenuti, ma anche nella raccolta, gestione e presentazione dei tuoi contenuti generati dagli utenti su tutti i tuoi punti di contatto di marketing.

Il miglior strumento di moderazione UGC per i marchi

Strategie di moderazione dei contenuti

Bene, analizziamolo. Immagina la moderazione dei contenuti come un lavoro di squadra: umani e tecnologia che uniscono le forze per mantenere il mondo online fantastico. Ecco lo scoop su come lo fanno:

Moderazione umana

È come avere degli amici attenti che ti guardano nel vicinato digitale. Guarda cosa stanno facendo:

- Importanza di team di moderazione ben formati e diversificati:

Persone diverse nel team significano prospettive diverse. Questo aiuta a cogliere cose difficili che le macchine potrebbero non cogliere. Come avere amici da tutto il mondo per mantenere le cose in equilibrio.

- Stabilire linee guida e protocolli chiari:

Consideratele come regole per assicurarvi che tutti giochino in modo corretto. I moderatori seguono queste regole per decidere se il contenuto è valido. È come avere delle regole di gioco per il parco giochi online.

- Come gestire il peso psicologico dei moderatori:

Guardare roba non proprio carina tutto il giorno può essere dura. I moderatori hanno bisogno di supporto per restare calmi. Dopotutto, sono gli eroi che mantengono le cose pulite e sicure.

AI e automazione

Ora, ecco i nostri aiutanti digitali che ci aiutano:

- Ruolo dell'apprendimento automatico nel rilevamento dei contenuti:

Le macchine apprendono schemi, come il tuo animale domestico che impara dove si trovano i dolcetti. Individuano cose che potrebbero non essere pertinenti elaborando tonnellate di informazioni. Ottimo per gestire carichi di contenuti.

- Vantaggi e limiti della moderazione automatizzata:

Le macchine sono intelligenti, ma non sono perfette. A volte non notano cose difficili o alzano una bandiera per errore. Sono come amici fidati che a volte hanno bisogno di una mano.

- La continua necessità di supervisione umana:

Gli umani hanno delle macchine segrete che non hanno la capacità di comprendere i sentimenti e le situazioni difficili. Ricontrollano ciò che le macchine trovano per assicurarsi che tutto sia a posto.

Mentre ti addentri nella moderazione dei contenuti, ricorda questo lavoro di squadra. Umani e tecnologia assicurano che il mondo online rimanga amichevole, divertente e rispettoso.

Il futuro della moderazione dei contenuti

Pronti a guardare nella sfera di cristallo della moderazione dei contenuti? Il futuro riserva emozionanti possibilità che plasmeranno il nostro modo di passare il tempo online. Scoprite cosa c'è all'orizzonte:

- Progressi nell'intelligenza artificiale e nella tecnologia:

Immagina che la tecnologia diventi ancora più intelligente, come il tuo animale domestico che impara nuovi trucchi. L'intelligenza artificiale diventerà più brava a individuare contenuti difficili, rendendo il mondo online più sicuro. Stiamo parlando di algoritmi super intelligenti che possono leggere le emozioni e comprendere il contesto come veri professionisti.

- Collaborazione tra piattaforme, decisori politici e utenti:

Immagina una squadra di supereroi che si unisce. Le piattaforme online, le persone che creano le regole e noi, gli utenti, lavoreremo mano nella mano. Ciò significa regole sensate e un parco giochi online che tutti contribuiscono a mantenere pulito.

- Formazione e responsabilità dell'utente nel contribuire a un ambiente digitale sicuro:

Immaginate che tutti noi diventiamo supereroi digitali. Come utenti, impareremo cosa è cool e cosa no nel mondo online. Proprio come impariamo a riciclare, contribuiremo a uno spazio digitale più pulito e gentile diventando netizen responsabili.

Quindi, preparatevi per un futuro in cui la tecnologia diventerà più saggia, le piattaforme e le persone collaboreranno per offrire un'esperienza online migliore e tutti contribuiranno a garantire che il mondo digitale rimanga divertente, rispettoso e fantastico per tutti.

Visualizza, nascondi, elimina da un posto

Conclusione

Uff, è stata una bella esplorazione! Riassumiamo tutto sulla moderazione dei contenuti e cosa ci aspetta:

Ricordate quegli eroi non celebrati che lavoravano dietro le quinte? La moderazione dei contenuti mantiene i nostri ritrovi digitali puliti, sicuri e pieni di vibrazioni positive. È come avere mani invisibili che assicurano che tutti si divertano.

Il cambiamento è una costante e il mondo online non fa eccezione. La moderazione dei contenuti continuerà a evolversi man mano che emergono nuove tendenze e sfide. Siate curiosi e aperti mentalmente, perché il viaggio è ben lungi dall'essere finito.

Mentre congediamo, brindiamo virtualmente ai supereroi digitali (i moderatori, i maghi della tecnologia e gli utenti responsabili) che rendono il regno online un rifugio accogliente per voci diverse, espressione creativa e interazioni rispettose.

Ecco a un futuro in cui il mondo online riflette il meglio dell'umanità: gentilezza, comprensione e unità. Continuate a esplorare, continuate a imparare e continuate a diffondere l'amore digitale!